Best GPU for AI 選購指南|如何挑選適合工作的 AI 顯示卡

人工智慧領域發展迅速。不論你是訓練大型語言模型(LLM),還是創作者想提升 4K 影片畫質,選擇最適合 AI 的顯示卡永遠是最重要的硬體決定。2026 年市場比以往更多元,專為 AI 設計的矽晶片能處理從巨型神經網路到即時生成藝術的一切任務。

第一部分:什麼樣的顯示卡適合 AI?

在機器學習領域,不是每張顯示卡都一樣。要找到最適合 AI 的顯示卡,不能只看遊戲效能,必須聚焦「運算」指標。

AI 最重要的規格

- CUDA / ROCm 支援: NVIDIA 的 CUDA 仍是業界標準,讓 NVIDIA 顯示卡成為 PyTorch、TensorFlow 等大多數函式庫最相容的選擇。

- VRAM 大小(8GB / 12GB / 24GB+): 顯示記憶體決定你能載入的模型大小。對本地工作站的深度學習顯示卡來說,24GB 是「甜蜜點」,企業級任務則需要 80GB 以上。

- Tensor Core / AI 加速器: 這些專用硬體單元專為矩陣乘法(AI 的核心運算)設計。

- 記憶體頻寬: 高頻寬(GB/s)確保資料在記憶體與核心間快速流動,避免瓶頸。

- 功耗與散熱: AI 任務常 100% 負載運行數小時甚至數天,強大的散熱管理不可或缺。

訓練 vs 推論 vs AI 創作

- 訓練: 需要最高 VRAM 與多顯示卡擴展(NVLink),從頭建構模型。

- 推論: 運行預訓練模型。優先穩定性與每查詢成本。

- AI 創作者: 專注在創作軟體中的顯示卡加速效能。這類使用者最受益於使用者友善工具的 GPU 加速,例如影片與影像增強。

第二部分:2026 年依使用情境推薦的最佳 AI 顯示卡

挑選最適合 AI 的顯示卡,需要將你的工作負載與硬體等級對應。以下是 2026 年的頂尖選擇。

1. 最佳 AI 訓練顯示卡(專業與企業級)

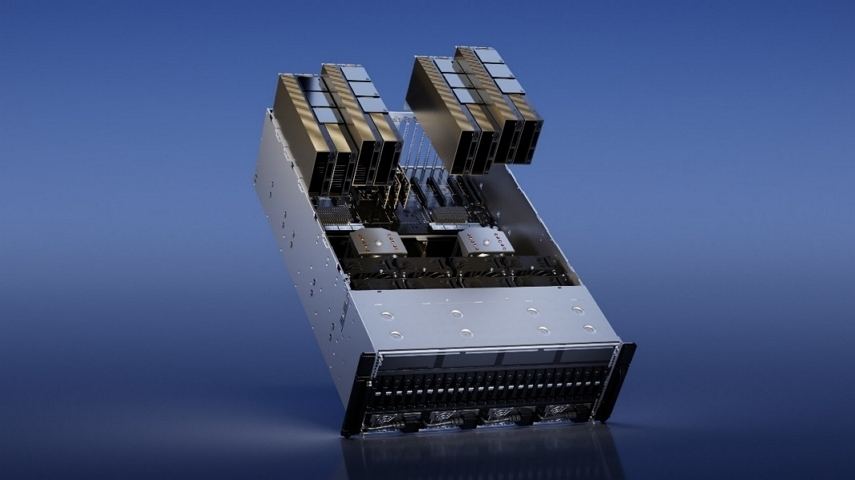

NVIDIA H100 / H200 Tensor Core

H 系列是 NVIDIA AI 訓練顯示卡的巔峰之作。H200 特別是 H100 架構的精進版,對大型語言模型(LLM)的容量幾乎翻倍。

最適合: 資料中心、研究機構與從頭訓練百億參數模型的公司。

關鍵規格:

- 推出日期: H100(2022年10月) / H200(2024年11月)

- 架構: Hopper

- 記憶體: 高達 141GB HBM3e(H200)

- 記憶體頻寬: 8 TB/s

- Tensor Core 效能: ~3,958 TFLOPS(FP8 + Sparsity)

- 功耗(TDP): 高達 700W(SXM) / 350-600W(PCIe)

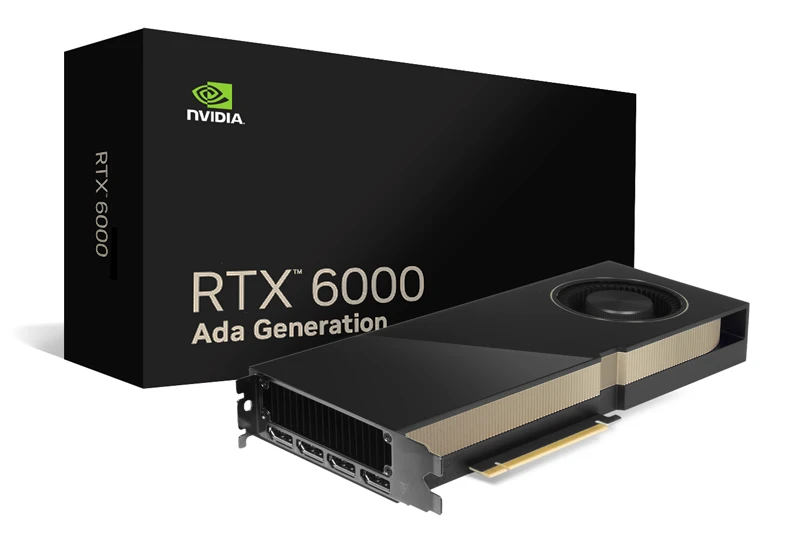

RTX 6000 Ada Generation

這是終極專業工作站顯示卡。擁有與 RTX 4090 幾乎相同的「大腦」,卻提供雙倍 VRAM 與專業驅動支援。

最適合: 需要高 VRAM 的 AI 研究人員與工程師,用於本地微調模型。

關鍵規格:

- 推出日期:2022年12月

- 架構:Ada Lovelace

- 記憶體:48GB GDDR6

- 記憶體頻寬:960 GB/s

- Tensor Core 效能:1,457 TFLOPS(Sparse)

- 功耗(TDP):300W

2. 最佳 AI 推論與部署顯示卡

NVIDIA RTX 4090

被廣泛認為是消費者級最佳 AI 顯示卡,4090 的 24GB VRAM 成為本地 LLM 推論的標準配備。

最適合: 獨立 AI 開發者與高端重度使用者。

關鍵規格:

- 推出日期:2022年9月

- 架構:Ada Lovelace

- 記憶體:24GB GDDR6X

- 記憶體頻寬:1.01 TB/s

- Tensor Core 效能:1,321 TFLOPS(Sparse)

- 功耗(TDP):450W

RTX 3090(性價比王者)

到了 2026 年,3090 仍是深度學習顯示卡的熱門選擇,因為它以低價提供 24GB VRAM。

最適合: 學生與預算有限的研究者。

關鍵規格:

- 推出日期:2020年9月

- 架構:Ampere

- 記憶體:24GB GDDR6X

- 記憶體頻寬:936 GB/s

- Tensor Core 效能:564 TFLOPS(Sparse)

- 功耗(TDP):350W

3. 最佳 AI 創作者顯示卡(影片、影像與生成式 AI)

NVIDIA RTX 4070

RTX 4070 是 AI 創作者最均衡的選擇。提供足夠 VRAM 與 Tensor Core 效能,能高效處理 AI 影片升級、影像增強與生成式 AI 工作流程。

最適合:

- AI 影片增強

- 影像與動畫生成

- 內容創作者

關鍵規格:

- 推出日期: 2023年4月

- 架構: Ada Lovelace

- 記憶體: 12GB GDDR6X

- 記憶體頻寬: 504 GB/s

- Tensor Core 效能: 466 TFLOPS(Sparse)

- 功耗(TDP): 200W

RTX 4060 Ti(16GB 版)

RTX 4060 Ti 是 AI 創作者與新手的入門選擇。雖然 VRAM 有限,但對輕量工作如 AI 影像增強與短片處理仍有出色加速。

最適合:

- 入門級 AI 創作者

- 學習 AI 工作流程

關鍵規格:

- 推出日期: 2023年5月

- 架構: Ada Lovelace

- 記憶體: 16GB GDDR6

- 記憶體頻寬: 288 GB/s

- Tensor Core 效能: 353 TFLOPS(Sparse)

- 功耗(TDP): 165W

第三部分:專業小撇步:用 GPU 優化軟體加速 AI 任務

擁有最適合深度學習的顯示卡是很好的基礎,但你使用的軟體決定實際生產力。對創作者來說,硬體效能常被優化不佳的工具拖累。

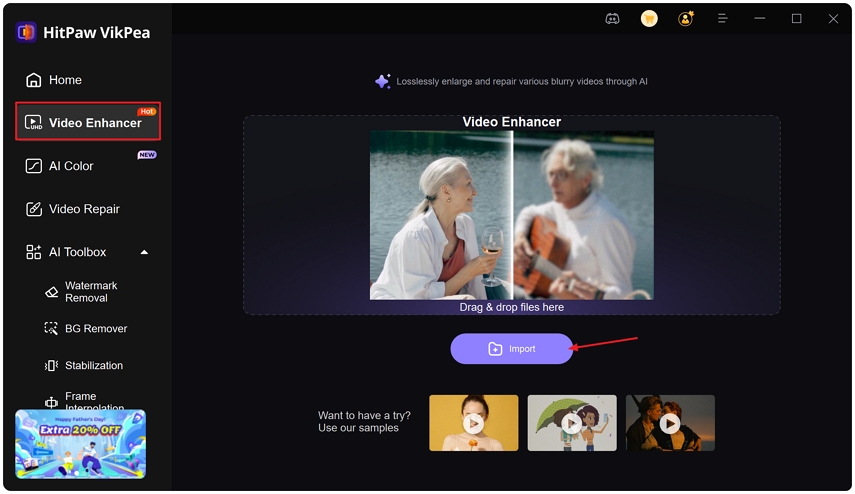

VikPea 是一款完全針對 GPU 加速優化的 AI 影片增強套件。不論你用 RTX 4090 還是較入門的 4060 Ti,VikPea 都能利用 NVIDIA 顯示卡的 Tensor Core,將任務加速最高 30 倍,比傳統 CPU 軟體快得多。

HitPaw VikPea 關鍵功能:

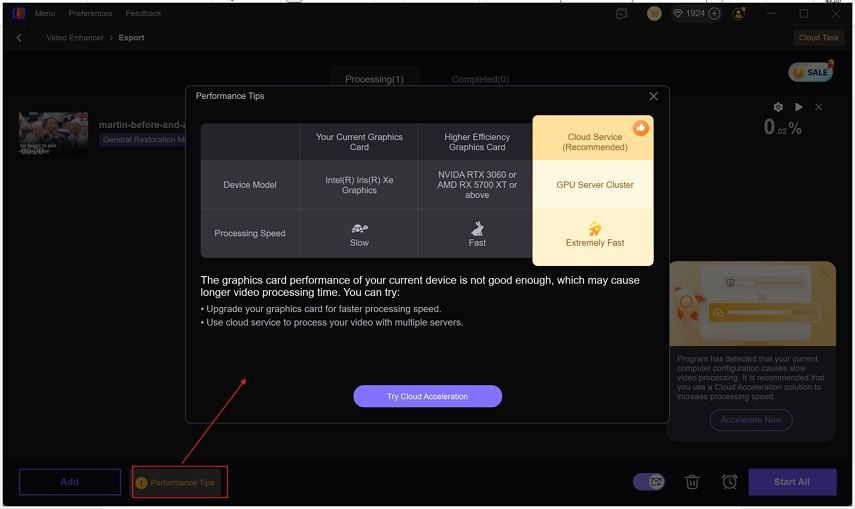

- 混合運算: 支援本地 GPU 加速與雲端運算,當本地硬體忙碌時可卸載重任務。

- 4K 影片升級: 將顆粒感的 1080p 畫面轉成電影級 4K,前所未有地快速。

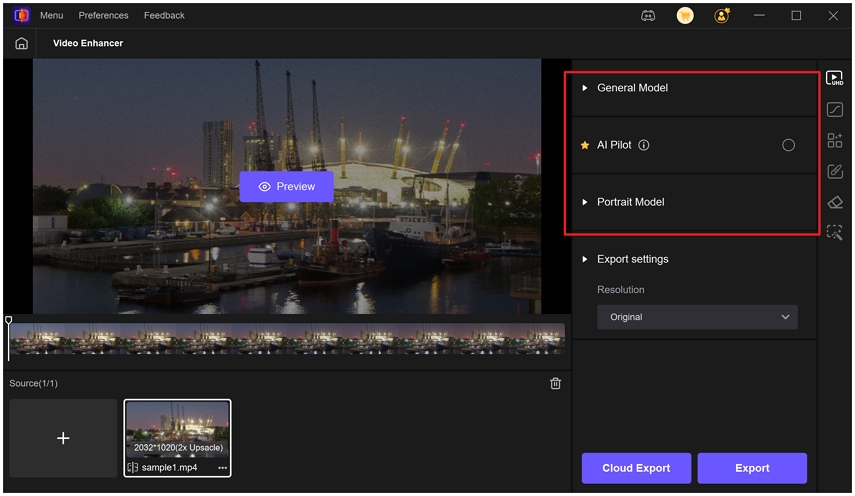

- 專屬 AI 模型: 包含通用模型(整體清晰度)、降噪模型(去除低光噪點)、人像模型(增強臉部細節與皮膚紋理)等。

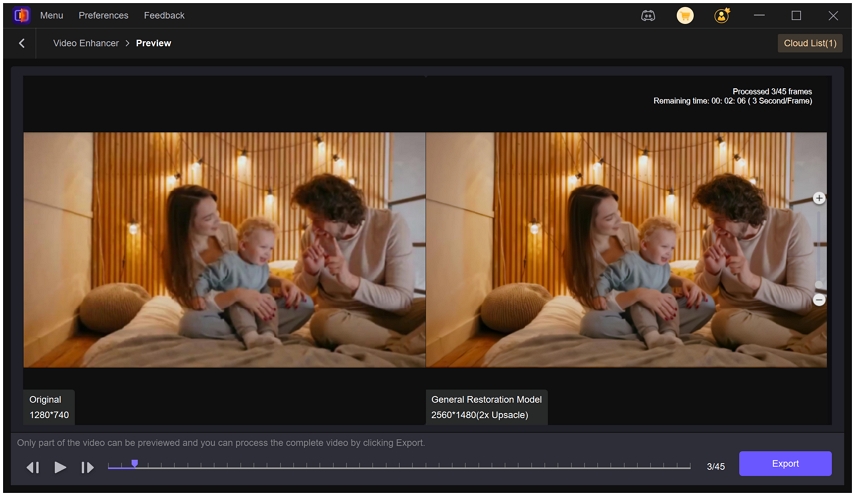

- 即時預覽: 提交最終匯出前,用分割畫面檢視 AI 效果。

使用 GPU 升級影片的逐步教學

步驟 1. 啟動與匯入:

開啟 VikPea,將影片拖放到「影片增強」模組。

步驟 2. 選擇模型: 挑選適合你影片的 AI 模型(例如 Vlog 用 人像 模型)。

步驟 3. 預覽: 點擊預覽按鈕,即時看到前後對比效果。

步驟 4. 加速匯出: 點擊匯出按鈕開始處理整支影片。VikPea 預設使用你的顯示卡加速。若選擇雲端匯出,速度更快。

第四部分:AI 顯示卡常見問題解答

視規模而定。個人使用與研究推薦 RTX 4090;企業訓練則以 NVIDIA H200 為當前金字塔頂端。

不是。RTX 4070 的 CUDA 核心與記憶體頻寬明顯更強,對深度學習任務效率高得多。

基本推論至少要 8GB VRAM 的顯示卡;訓練則強烈建議 24GB 以上。

OpenAI 使用大量 NVIDIA H100 與 A100 顯示卡叢集來訓練 GPT-4 與 Sora 等模型。

目前 NVIDIA 因 CUDA 生態系支援最廣,仍是 AI 開發的主流平台。

結語

選擇最適合深度學習或內容創作的顯示卡,需要平衡 VRAM、運算能力與軟體相容性。雖然 NVIDIA 在硬體上領先,但像 VikPea 這樣的工具能確保你從顯示卡投資中榨出最大效能,透過 GPU 加速優化。

留下您的評論

分享您對 HitPaw 文章的想法與回饋